تتجه عصابات الاحتيال إلى العالمية - وتذهب إلى التكنولوجيا الفائقة.

ما كان في السابق نشاطًا على مستوى الشارع أصبح الآن عملية بمليارات الدولارات مدعومة بالذكاء الاصطناعي التوليدي ومحافظ التشفير المجهولة. في الوقت الذي تقوم فيه الحكومات في جميع أنحاء شرق وجنوب شرق آسيا بقمع عصابات الاحتيال المحلية بشدة، فإن هذه الجماعات الإجرامية لا تتراجع - إنها تعيد اختراع نفسها.

وفقًا لتقرير* صادر عن مكتب الأمم المتحدة المعني بالمخدرات والجريمة، تتطور الجريمة المنظمة إلى صناعة التكنولوجيا المعولمة، مع قيام مراكز الاحتيال بتصنيع أساليبها وغسل المليارات عبر الحدود. أصبحت شبكة الويب المظلمة والتزوير المدعوم بالذكاء الاصطناعي والخدمات المصرفية السرية كلها أدوات في اقتصاد الجريمة الرقمية الجديد هذا.

وواحدة من أخطر الأدوات على الإطلاق؟ ديب فيك.

كيف يخدع المحتالون أنظمة التحقق

Deepfake - اختصار لـ «التعلم العميق + المزيف» - لم يعد مجرد مولد للميمات الفيروسية بعد الآن، ولكنه سلاح يستخدم في دليل المحتال. بدعم من الذكاء الاصطناعي، يمكن لـ deepfakes تحويل عدد قليل من الصور إلى مقاطع فيديو نابضة بالحياة - كاملة بالوميض الطبيعي وإمالة الرأس وحتى التعبيرات الدقيقة. ما كان يستخدم في استوديو المؤثرات البصرية يمكن الآن القيام به على جهاز كمبيوتر محمول. قد يكون هذا خبرًا سيئًا لأي شخص يعتمد فقط على التعرف على الوجوه ثنائي الأبعاد.

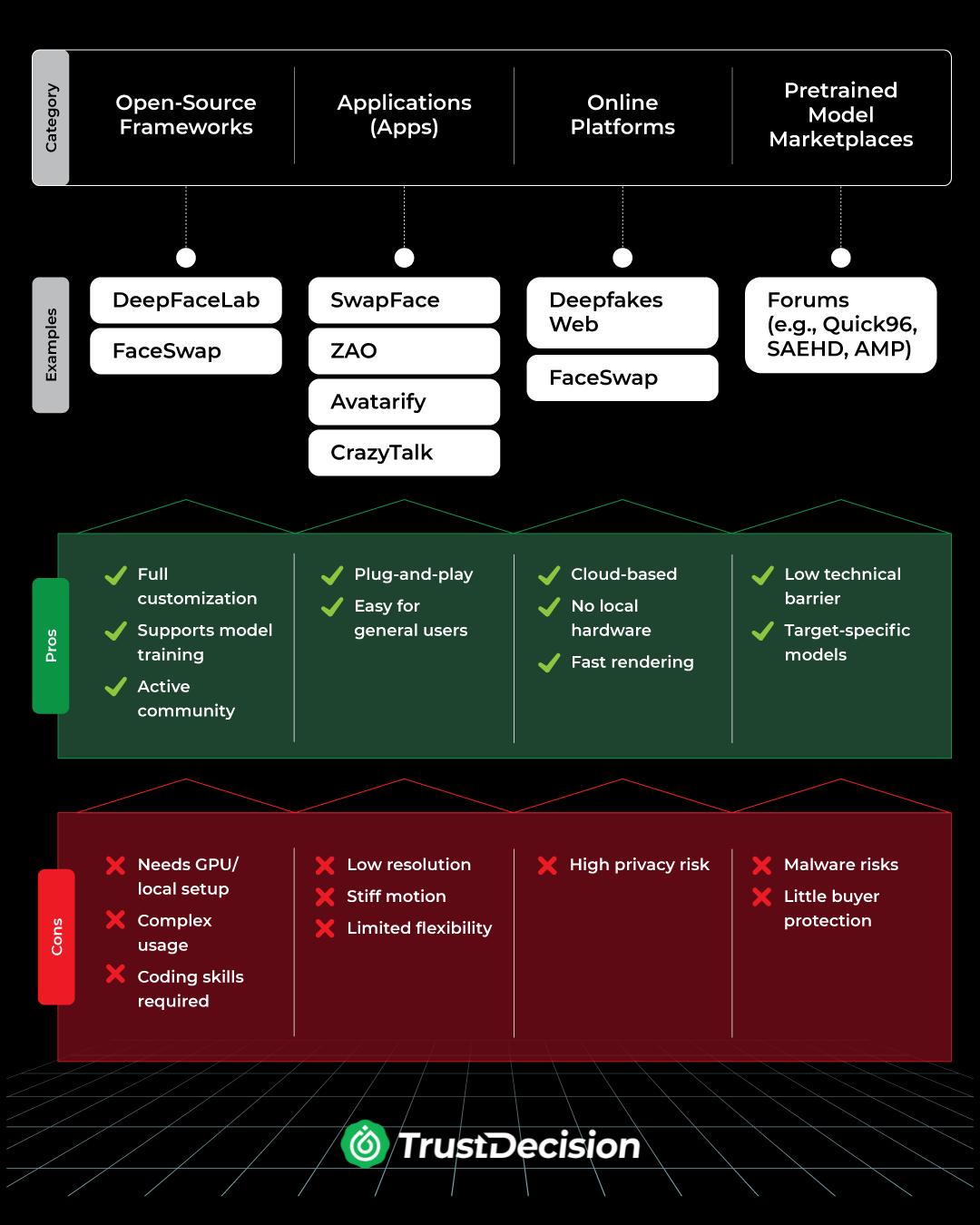

أدوات Deepfake: ماذا يوجد هناك؟

من التعليمات البرمجية مفتوحة المصدر إلى تطبيقات التوصيل والتشغيل، يمتلك المحتالون اليوم مجموعة أدوات كاملة. فيما يلي تفصيل:

كيف يتم تصميم Deepfakes لتجاوز التحقق البيومتري

بمجرد تجهيز المهاجمين بالأدوات المناسبة، يبدأ المهاجمون في وضع خطتهم موضع التنفيذ. فيما يلي نظرة خطوة بخطوة على كيفية تصميم مقاطع الفيديو الاصطناعية لتجاوز أنظمة مصادقة الوجه:

- جمع البيانات - يحدد المحتال هدفًا ويستخدم أساليب الاحتيال أو الهندسة الاجتماعية للحصول على بياناته البيومترية - مثل الصور أو مقاطع الفيديو أو عينات الصوت.

- النمذجة الديناميكية - باستخدام البيانات التي تم جمعها، يقوم المهاجم ببناء نموذج يكرر ملامح وجه الهدف وحركاته.

- عرض الفيديو - باستخدام هذا النموذج، يقومون بإنشاء رسوم متحركة واقعية، غالبًا ما يتم تحسينها بتأثيرات الإضاءة الخاصة (مثل تراكبات RGB)، لتقليد معدلات الوميض الطبيعية وحركات الرأس - لتفادي اكتشاف الحيوية ثنائية الأبعاد بشكل فعال.

- تنفيذ الهجوم - يتم بعد ذلك حقن الفيديو المزيف في مكالمة فيديو أو تحميله في نظام التحقق البيومتري. من خلال استغلال العيوب مثل اكتشاف الوميض المستند إلى الإطارات، يتم خداع النظام - ويظهر المهاجم على أنه المستخدم الحقيقي.

استجابة المؤسسة لتهديدات Deepfake

نظرًا لأن هجمات التزييف العميق تزداد تعقيدًا، فمن الأهمية بمكان أن تتجاوز الشركات عمليات التحقق التقليدية من KYC. تتبنى المنظمات الرائدة الآن دفاعات ذكية متعددة الطبقات لتحديد التلاعب في وقت مبكر والاستجابة بشكل أسرع.

تعزيز حماية الحساب

من خلال مراقبة سلوك تسجيل الدخول وأنماط الأجهزة وحالات الوصول الشاذة، يمكن للمؤسسات اكتشاف التهديدات مثل أحصنة طروادة للوصول عن بُعد (RATs) أو حشو بيانات الاعتماد قبل بدء التحقق من الهوية.

تعزيز الدفاعات البيومترية باستخدام الذكاء الاصطناعي

تستفيد الأنظمة البيومترية الحديثة من الذكاء الاصطناعي لاكتشاف التناقضات الدقيقة في ديناميكيات الوجه، وتتجاوز بكثير الكشف الأساسي عن الوميض أو الحركة لاكتشاف محاولات التزييف العميق.

دمج ذكاء الجهاز

تُستخدم إشارات نقطة النهاية - مثل استخدام المحاكي أو عمليات إعادة الضبط المتكررة أو عدم تطابق الأجهزة - بشكل متزايد للكشف عن الأجهزة المخادعة وإيقاف الاحتيال من مصدرها.

سلوك النمذجة في السياق

يمكن أن تحاكي مقاطع الفيديو الاصطناعية المظاهر، ولكن ليس السلوك الحقيقي. من خلال الجمع بين خطوط الأساس السلوكية والذكاء الخارجي، يمكن للمؤسسات إنشاء ملفات تعريف ديناميكية للمخاطر والإبلاغ عن الأنشطة المشبوهة في الوقت الفعلي.

تعرف على المزيد حول كيفية عمل الاحتيال الذي يدعم التزييف العميق، وكيفية البقاء في المقدمة في أحدث فيديو لدينا من Deepfakes إلى القروض المزيفة: الوجه الجديد للاحتيال في الإقراض.

المراجع

مكتب الأمم المتحدة المعني بالمخدرات والجريمة. (2025). نقطة الانعطاف: الآثار العالمية لمراكز الاحتيال والخدمات المصرفية السرية والأسواق غير المشروعة عبر الإنترنت في جنوب شرق آسيا. https://www.unodc.org/roseap/uploads/documents/Publications/2025/Inflection_Point_2025.pdf

.jpeg)